本文来源于数据从业者全栈知识库,更多体系化内容请访问知识库。

什么时候才该 Fine-tune:2026 决策框架

引用Fine-tuning 不是默认选项,是最后选项。先穷尽 RAG、Prompt、工具调用,还解决不了的问题,才考虑 SFT。

前置知识阅读本文前,建议先了解:

- RAG 检索增强生成实战 — 理解 RAG 的边界在哪里

- Prompt Engineering 提示工程 — 知道 Prompt 能做到什么程度

- 大模型微调与私有化部署 — Fine-tune 的技术实操细节

目录

- #三个”本不该发生”的 Fine-tune 故事

- #RAG 和 Prompt 能解决的 80% 场景

- #Fine-tune 真正的适用场景(不到 20%,但刚需)

- #Fine-tune 的五个陷阱

- #决策框架:5 步问答

- #成本对比:三种方案的 TCO

- #SFT、DPO、LoRA 怎么选

- #2026 年真值得 Fine-tune 的三个场景

- #落地路线:最稳的三步走

三个”本不该发生”的 Fine-tune 故事

故事一:客服升级项目

某家零售公司,客服机器人偶尔给出过时的退货政策信息。产品经理开会定了方向:“我们要 Fine-tune 一个懂公司政策的模型。”

于是数据团队花了三个月:整理标注数据、搭训练环境、跑 LoRA、评估、上线。

结果还不如一个工程师花两天搭的 RAG 系统——把退货政策文档扔进向量库,每次回答前检索最新版本。

问题的本质是实时信息访问,Fine-tune 解决不了”模型权重是静态的”这个事实。你今天训练,明天政策改了,再训一遍。

故事二:企业知识库

另一家公司,内部有几千份产品手册、流程文档。CTO 提议:“把这些都喂给模型,训一个懂我们业务的专属 AI。”

听起来很自然。实际上,Fine-tune 训练的是模式,不是事实。你把文档喂进去训练,模型学到的是”这类问题该怎么回答”的语气和格式,不是”具体数字和最新版本”。

更糟的是,如果文档里有矛盾(一份旧的说 A,一份新的说 B),模型会在两者之间随机摇摆,而且你根本不知道它在哪个版本上。

RAG 的做法是:你问一个问题,系统检索最相关的几段原文,连同原文一起送给模型做推理。信息来源透明,版本可控。

故事三:“懂我们业务”的模型

第三家是一家 SaaS 公司,希望构建一个能回答用户操作问题的助手。需求是:用我们的产品语言回答,不要通用废话。

这个需求用 System Prompt 加几十个 Few-shot 示例就解决了。把产品文档的 Q&A 整理成高质量 Prompt 模板,GPT-4o 调出来的效果比自己 Fine-tune 7B 模型强了一个层级,成本也低。

这三个故事的共同错误是:把”模型不知道某些信息”和”模型不具备某种能力”混为一谈。

前者用 RAG 和 Prompt 注入,后者才考虑 Fine-tune。

RAG 和 Prompt 能解决的 80% 场景

大多数企业以为自己需要 Fine-tune 的问题,其实在这张表里:

| 需求类型 | 具体场景 | 推荐方案 | 原因 |

|---|---|---|---|

| 知识更新 | 产品文档、政策、FAQ 更新 | RAG | 权重是静态的,RAG 支持实时检索 |

| 业务规则 | 按公司流程回答问题 | System Prompt + 规则注入 | Prompt 能精确传递规则 |

| 语气一致 | 客服语气、品牌腔调 | Few-shot Prompt | 给 10 个示例通常够用 |

| 摘要分类 | 邮件归类、评论分析 | 基础 Prompt 工程 | 通用模型本来就擅长 |

| 结构化输出 | JSON、Markdown 格式 | Prompt + Function Calling | GPT-4o、Claude 3.5 原生支持 |

| 工具调用 | 查数据库、调 API | Function Calling / MCP | MCP 协议 专为此设计 |

| 简单 Q&A | 事实查询、内容检索 | RAG + 向量搜索 | 知识存在外部库,准确率更高 |

一个快速判断方法如果你的问题可以写成”我需要模型知道 X”,那通常是 RAG 问题。 如果你的问题是”我需要模型能做 X(而通用模型做不到)“,才考虑 Fine-tune。

Fine-tune 真正的适用场景(不到 20%,但刚需)

这些场景不是”Fine-tune 会更好”,而是没有 Fine-tune 就无法解决:

1. 输出格式极度结构化

医院要求 LLM 输出标准化病历格式:固定字段、固定顺序、固定编码体系。这套格式不是 JSON 那么简单,是有几十个强制字段、有层级、有业务约束的结构。

用 Prompt 控制,偶尔会漂移。用 RAG,检索出来的内容还是要经过一层生成才能格式化。Fine-tune 让模型直接”肌肉记忆”这个格式,零漂移。

2. 领域术语密度极高

法律合同里的措辞、金融产品说明书里的专有名词、药品说明书里的 IUPAC 命名——通用模型会理解错,或者生成出同义但错误的表达。

在这类场景里,训练数据里的术语对齐比什么都重要。Fine-tune 让模型在这个领域的词汇空间里工作,而不是在通用语言空间里猜。

3. 高并发 + 低延迟 + 成本敏感

调用 GPT-4o API 处理一个文档,平均 300ms,成本约 0.01 美元。如果业务是每天 100 万次调用,每年成本是 365 万美元。

Fine-tune 一个 7B 的小模型部署在自己的机器上,单次推理 50ms,跑满了每年成本 15 万美元——成本压到 1/24。

这不是技术优越,是算数。

4. 数据主权和合规要求

欧盟 GDPR、中国数据安全法、医疗数据三级等保——有些数据不能出境,不能上公有云。你必须在本地跑模型。

本地跑 70B 模型需要 8 张 A100,租不起。Fine-tune 一个 7B 模型,在普通 GPU 服务器上跑,效果可以接近 70B。

5. 风格一致性有严格要求

不是”大概像我们品牌”,而是”每一句话的句式、用词、表达习惯必须通过合规审查”。金融机构的客户沟通话术、保险产品的条款解释——这类场景用 Few-shot 不够稳定,Fine-tune 是唯一能让风格稳定收敛的方法。

Fine-tune 的五个陷阱

决定 Fine-tune 之前,这五个问题至少要想清楚三个:

陷阱 1:通用能力损失(Catastrophic Forgetting)

Fine-tune 之后,模型会在训练分布上变强,但在训练分布之外会变弱。你用内部文档训练的医疗模型,可能忘了怎么做基础数学推理。这不是 bug,是 SFT 的基本特性。

如果你的产品除了专业问答还需要通用能力(比如解释、对话、推理),Fine-tune 后的效果可能让你失望。

陷阱 2:数据漂移导致效果退化

你今天训练的模型,在六个月后可能表现变差——不是模型坏了,是世界变了但模型没变。

业务逻辑更新了、术语变了、新产品上线了——Fine-tune 的模型不会自动更新。你必须重新收集数据、重新训练。这是一个持续性工程,不是一次性任务。

陷阱 3:维护成本高

Fine-tune 不只是跑一遍训练那么简单。你需要:

- 维护训练数据集(版本管理、去重、质量审核)

- 评估体系(怎么知道新版模型比旧版好)

- 部署基础设施(GPU 服务器、推理框架、监控)

- 模型版本管理(哪个版本在生产、哪个在测试)

大多数公司低估了这部分。训练一次三天,维护体系搭起来要三个月。

陷阱 4:数据质量门槛高

Fine-tune 的效果上限由数据质量决定。5000 条高质量数据,比 50000 条低质量数据训出来的模型好得多。

但”高质量”的定义是:标注准确、覆盖场景均匀、没有相互矛盾的标注。收集这样的数据,往往需要领域专家标注,成本很高。

参考AI 数据标注与数据飞轮了解数据质量工程的全貌。

陷阱 5:评估困难

Fine-tune 之后,怎么知道效果好不好?

传统的准确率指标不够用。你需要一套和业务强绑定的评估集,覆盖真实失败案例。如果没有系统性评估,你可能解决了一个问题,但引入了三个你不知道的问题。

详见LLM 评估体系。

决策框架:5 步问答

这五个问题是有顺序的。每一步都是一个退出点。能在早期退出就在早期退出,越往后走,沉没成本越高。

成本对比:三种方案的 TCO

以一个中等规模企业的业务场景为基准——每天 10 万次 LLM 调用,需要专业领域能力。

一次性成本

| 项目 | RAG + 基础 Prompt | 高级 Prompt + 工具 | Fine-tune(LoRA) |

|---|---|---|---|

| 工程开发 | 4-8 周 | 2-4 周 | 8-16 周 |

| 数据准备 | 文档整理,2-4 周 | 示例整理,1-2 周 | 标注数据,12-24 周 |

| 基础设施 | 向量库(约 ¥2000/月) | 无额外费用 | GPU 训练(约 ¥20000 一次) |

| 评估体系 | 基础 eval,2 周 | 基础 eval,1 周 | 完整 eval 体系,4-8 周 |

6 个月运营成本(每天 10 万次调用)

| 方案 | API 调用费 | 基础设施费 | 人力维护 | 6 个月总计 |

|---|---|---|---|---|

| RAG + GPT-4o | ¥45 万 | ¥1.2 万(向量库) | 0.5 人/月 × 6 | ~¥55 万 |

| Prompt + GPT-4o | ¥45 万 | 无 | 0.2 人/月 × 6 | ~¥50 万 |

| LoRA 微调 7B 本地 | 无(本地推理) | ¥18 万(GPU 租用) | 1 人/月 × 6 | ~¥90 万 |

| LoRA 微调 7B 自建 | 无 | ¥6 万(折旧) | 1 人/月 × 6 | ~¥60 万(初期硬件投入另算) |

关键结论Fine-tune 在 6 个月内几乎不省钱——人力成本和基础设施前期投入很重。真正的成本优势在 12-24 个月后才体现,前提是调用量足够大(每天 100 万次以上)。

如果你的日调用量低于 10 万,Fine-tune 的 TCO 永远不会低于直接调 API。

详细成本优化策略见LLM 成本控制与优化。

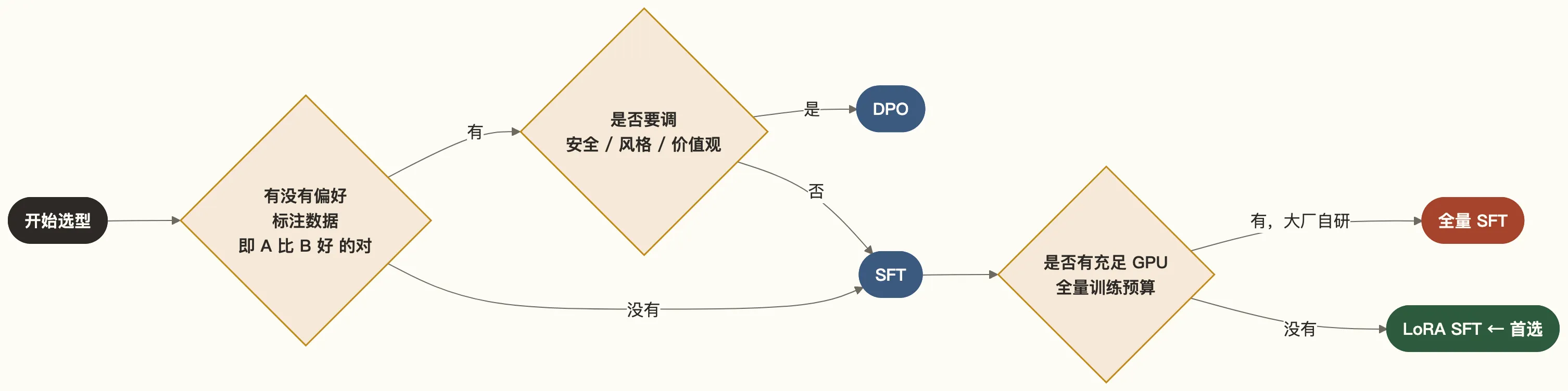

SFT、DPO、LoRA 怎么选

已经确认要 Fine-tune 了,下一个问题是选哪种方式。

三者的本质区别

SFT(Supervised Fine-Tuning,有监督微调)

给模型看大量”输入-输出”对,让它学会在给定输入下生成正确输出。这是最基础的 Fine-tune 方式。

适用场景:有明确”正确答案”的任务——格式化输出、特定领域 Q&A、翻译风格对齐。

DPO(Direct Preference Optimization,直接偏好优化)

不是给正确答案,而是给”A 比 B 好”的偏好对。模型学会在两个输出中选择人类更偏好的那个。

适用场景:需要调整回答风格、安全偏好、语气一致性——当你有人工偏好标注数据时。大多数企业没有这类数据,所以 DPO 用得少。

LoRA(Low-Rank Adaptation,低秩适配)

不是技术路线,是参数效率技术。在 SFT 或 DPO 的基础上,只更新少量适配层参数,而不是全量更新模型权重。

优点:显存需求减少 60-80%,训练速度快 3-5 倍,可以叠加多个 LoRA 适配器切换场景。 缺点:效果上限低于全量 SFT,但对于大多数企业场景足够用。

选型原则

结论:大多数企业场景,LoRA SFT 是起点。全量 SFT 是大厂自研 Foundation Model 时的选择。DPO 是有偏好数据时的进阶选择。

2026 年真值得 Fine-tune 的三个场景

场景 1:医疗病历结构化

背景:三甲医院需要将医生口述病历转换为符合 HL7 FHIR 标准的结构化电子病历。

为什么是 Fine-tune 刚需:

- 输出格式有强约束(FHIR R4 标准,几十个必填字段)

- 医学术语密度极高(ICD-10 编码、SNOMED CT 术语体系)

- 数据不能上公有云(医疗数据三级等保要求本地部署)

- Prompt 控制在生产环境下有 3-8% 的格式漂移率,不可接受

实际效果:Fine-tune 7B 模型在内部医疗数据上,关键字段提取准确率从 GPT-4o + Prompt 的 89% 提升到 97%,且格式漂移率降到 0.2%。

场景 2:法律合同条款抽取

背景:律所需要从合同中抽取约定条款,识别潜在风险点,输出标准化风险报告。

为什么是 Fine-tune 刚需:

- 法律术语具有极强的专业性(“不可抗力”在不同法系下含义不同)

- 通用模型在条款语义理解上有 15-20% 的错误率

- 高并发需求(每天处理数万份合同),API 成本无法承受

实际效果:使用领域标注数据(专业律师标注 8000 份合同)Fine-tune 后,条款识别 F1 值从 0.74 提升到 0.91,且单次处理成本降低 85%。

场景 3:边缘部署小模型

背景:工厂设备上的 AI 助手,需要在本地嵌入式设备运行,无网络依赖,响应时间 <50ms。

为什么是 Fine-tune 刚需:

- 设备算力有限(只能跑 7B 以下的模型)

- 无网络,无法调用云端 API

- 业务场景专一(只处理设备故障问答,知识面窄但专业度高)

实际效果:Fine-tune 3B 模型在故障诊断场景上,效果接近 GPT-4o;推理延迟 30ms,比调 API 快 10 倍。

落地路线:最稳的三步走

如果你已经决定探索 Fine-tune,不要第一天就开始训练。

Step 1:先用 RAG + 优化 Prompt 跑 3 个月,系统性收集 Bad Case

这一步的目的不是”等 RAG 失败”,是搞清楚失败的模式。

记录每一个 RAG/Prompt 解决不了的案例,打上失败原因标签:

- 格式不对

- 术语理解错误

- 延迟太高

- 输出不稳定

如果 3 个月后,Bad Case 集中在”格式/术语/延迟”而不是”知识检索”,才进入下一步。

Step 2:用 Bad Case 的失败模式决定是否 Fine-tune,以及训什么

Bad Case 的失败模式决定你的训练数据方向。不要拿公司所有文档喂进去,要针对性地建训练集:

- 格式问题 → 收集格式正确的标准输出对

- 术语问题 → 收集专业标注的术语理解对

- 风格问题 → 收集偏好标注对(准备用 DPO)

5000 条高质量、针对性的数据,远比 50000 条泛化数据有效。

Step 3:先用 LoRA 小样本试水,再考虑扩大

不要第一次就全量训练。用 500-1000 条数据跑一个 LoRA 原型:

- 验证你的数据质量假设

- 验证评估指标的有效性

- 验证基础设施能不能跑起来

小样本试水失败,可以快速调整方向。全量训练失败,代价大很多。

配套参考

- 技术实操细节:大模型微调与私有化部署

- 数据质量工程:AI 数据标注与数据飞轮

- 评估体系建设:LLM 评估体系

掌握检查

- 能说清楚 RAG 和 Fine-tune 各自能解决什么问题、解决不了什么问题

- 能用 5 步决策树判断一个具体业务需求是否值得 Fine-tune

- 理解 SFT、DPO、LoRA 的适用场景区别,知道大多数企业应该从哪里起步

- 能估算 Fine-tune 和 RAG 方案在 6 个月、12 个月的 TCO 差距

- 知道 Fine-tune 的五个主要陷阱,以及如何在立项阶段识别风险

实践练习

基础题:你的公司有一个 HR 问答系统,员工经常问”我的年假还有多少天”。有人提议 Fine-tune 一个模型来回答这类问题。请用决策框架判断是否应该 Fine-tune,并说明理由。

进阶题:假设你负责一个金融风控系统,需要从贷款申请材料中抽取标准化风险字段。每天处理 5 万份申请,字段格式有严格规范,部分专业术语通用模型理解不准。请:

- 判断是否适合 Fine-tune

- 选择 SFT / DPO / LoRA 中的哪种方案

- 制定数据收集计划(数量、质量要求、标注方式)

挑战题:设计一套评估方案,用于判断 Fine-tune 之后的模型是否真的比 RAG + Prompt 方案好。评估维度至少包含:准确率、格式稳定性、通用能力保留、成本效益。

下一步

本文是决策判断文。如果你已经确认要 Fine-tune,技术实操请移步:

大模型微调与私有化部署 — LoRA 训练、推理部署、模型版本管理全流程

如果你还在优化 RAG 和 Prompt,延伸阅读:

- RAG 检索增强生成实战 — 把 RAG 做到极致

- Prompt Engineering 提示工程 — 更系统的 Prompt 设计方法

写于 2026-04-19。Fine-tune 的技术细节演进很快,但这个决策框架的底层逻辑不会变:先穷尽低成本方案,再考虑高成本方案。