这一周,两个巨头同时掏出了 AI 编程代理,Flink 造了个能跑 AI Agent 的流处理引擎,而初级数据岗的招聘还在缩。

消息很多,值得停下来想一想的没几条。这篇只说我觉得重要的。

行业动态:产品与技术

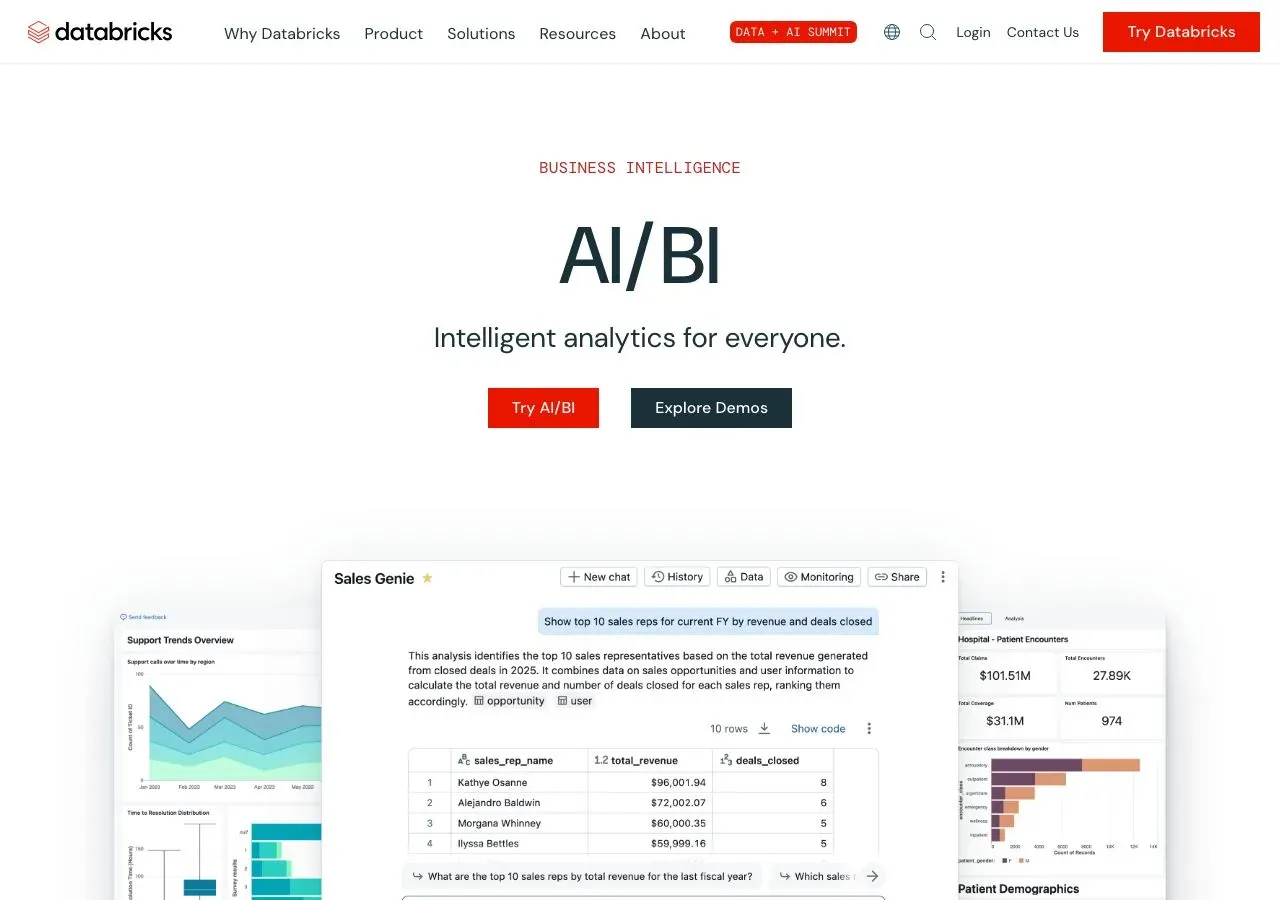

Databricks 推出 Genie Code——让 AI 自己写代码查数据

3 月底,Databricks 正式上线了 Genie Code,这不是一个简单的 SQL 补全工具,而是一个自主编程代理(autonomous coding agent)。

它能做什么?接到一个业务问题后,Genie Code 自己拆任务,写 Python 或 SQL,跑一遍,发现不对就自己调试——循环往复,直到给出答案。以前你花半天写的取数脚本,它可能十分钟搞定,而且还会自查。

配套的还有一个叫 Inspect 的功能(目前公测中),专门用来「复查」生成的 SQL——先把大查询拆成小块验证,确认逻辑没问题后再拼回去。

另外,Agentic Dashboard Authoring 也一并发布:用一句话描述你要看什么数据,AI 从找表、建数据集、画图表、配筛选条件到排版多页仪表盘,一条龙搞定。

这意味着什么?对数据分析师来说,取数和建仪表盘这两项最消耗时间的日常工作,正在被 AI 接管。

Snowflake 的 Cortex Code 全面开放

几乎同一时间,Snowflake 也没闲着。

Cortex Code 在 Snowsight(Snowflake 的 Web 界面)中已正式 GA(General Availability)。这同样是一个 AI 编程代理,但 Snowflake 走了一条不同的路——它不仅支持 Snowflake 原生工作流,还在 CLI 端扩展到了 dbt 和 Apache Airflow 的支持。

换句话说,Snowflake 想让 Cortex Code 成为一个跨平台的数据工程 AI 助手,不管你的管道跑在哪里,它都能帮你写代码。

更值得注意的是它的 Agent Teams 功能——多个 AI Agent 协同并行工作,这已经不是”AI 辅助”了,这是”AI 团队”。

底层模型可选 Claude Opus 4.6 和 GPT-5.2——Snowflake 不绑死模型供应商,这倒是个聪明的姿态。

Databricks vs Snowflake:一场 Coding Agent 军备竞赛

退后一步看,两家数据平台巨头同时在 2026 年 Q1 押注 Coding Agent,不是巧合。

| 维度 | Databricks Genie Code | Snowflake Cortex Code |

|---|---|---|

| 核心能力 | 自主写 Python/SQL + 自动调试 | AI 编程 + 跨平台管道支持 |

| 集成生态 | Microsoft Copilot Studio、Teams | dbt、Apache Airflow、CLI |

| 差异化 | 深度绑定 Lakehouse 生态 | 向外扩展,支持非 Snowflake 环境 |

| 协作模式 | Genie Agent Mode(多步推理) | Agent Teams(多 Agent 并行) |

它们解决的是同一个问题:数据工程师和分析师的时间不该花在重复性编码上。

策略不同。Databricks 在自己的城池里深挖,Snowflake 想翻过墙去够别人家的场景。谁赢不好说,但有一点确定——“手写 SQL 然后等结果”这件事,正在从日常变成偶尔。

Apache Flink CDC 3.6 发布 + Flink Agents 子项目亮相

开源生态这边也没停。

Flink CDC 3.6 在 3 月 30 日发布,继续完善变更数据捕获(CDC)的能力。同时,Flink Kafka Connector 升级到了 Kafka 4.2.0。

但真正让人注目的是 Flink Agents(FLIP-531)。

这是一个全新的子项目,目标是在 Flink 之上构建事件驱动的 AI Agent。它支持动态拓扑——简单说就是 AI Agent 能根据上一步结果决定下一步做什么(ReAct 循环、条件分支)。可以调用外部工具(MCP 协议),并且继承了 Flink 的 checkpoint 和 exactly-once 语义,也就是说,哪怕系统崩了重启,数据也不丢不重。

翻译成人话:你可以在流处理引擎里直接跑 AI Agent,而且它保证数据不丢不重。

对于需要在实时数据流上做 AI 决策的场景(比如实时风控、动态定价),这可能是 2026 年最重要的基础设施级创新之一。

市场现状:数据岗的「冷静期」

就业市场:入门更难,高端更香

产品发完了,聊聊人。

多项报告指出,2026 年初级数据岗位(尤其是 30 岁以下的 junior 到 mid-level)的招聘需求出现了明显收缩。不是岗位消失了,而是竞争更激烈了,企业的要求也更高了。

五年前,会 SQL + Python 就能拿到 offer。现在?这只是入场券。

招聘 JD 里越来越常见的关键词是:平台工程、DevOps 集成、ML Pipeline、数据治理编排——一个岗位干四个人的活。

与此同时,高级数据岗位的薪资依然坚挺。美国市场数据工程师薪资区间 138K(初级到高级),数据科学家 182K。国内上海市场,56.3% 的数据分析师岗位月薪在 20-50K 之间。掌握 Python + BI 组合技能的人,薪资溢价可达 27.3%。

需求变化:从「数据分析师」到「AI 增强分析师」

行业对数据人才的需求没有减少——全球数据分析市场预计 2026 年底达到 1044 亿美元,年增长率 21.5%。美国劳工统计局预计数据科学家岗位到 2034 年增长 34%。

但需求的内涵变了。

「数据分析师」这个 title 正在被重新定义,可能的新名字包括:Analytics Engineer、Business Insights Analyst、AI-Augmented Analyst。企业不再只需要你取数做报表,而是希望你能编排 AI + 数据 + 业务。

数据工程师也一样。2026 年的数据工程已经不是写 ETL 就完事了——cloud-native 管道、流式架构、Data Mesh、治理框架,每一项都在向「架构能力」靠拢。

用一句话总结:市场不是不要数据人了,是不要只会干活的数据人了。

突破口在哪里?

说了这么多坏消息,聊点有建设性的。

第一,成为 AI 的驾驶员,而不是被 AI 替代的乘客。

Databricks 的数据显示,平台上 80% 的新数据库已经由 AI Agent 自动创建。Snowflake 和 Databricks 都在推 Coding Agent。这些工具会取代「写 SQL」这件事本身吗?不一定。但它们一定会取代「只会写 SQL」的人。

学会用这些工具,让 AI 做重复工作,你做判断和决策——这不是锦上添花,是生存技能。

第二,「T 型能力」比任何单项技能都值钱。

纵向:Python、SQL、机器学习、大模型原理——这是你吃饭的手艺。 横向:业务理解、沟通能力、项目推动——这是你值钱的理由。

见过太多技术很强的人,写的代码自己看得懂,老板看不懂,客户更看不懂。能把技术翻译成业务价值的人,永远稀缺。

第三,关注实时和流式。

Flink Agents 的出现不是偶然。批处理时代的「隔夜跑数」正在被实时架构取代。Kafka + Flink 已经成为主流企业的标配。如果你还只会 Hive + Spark 批处理,是时候补课了。

第四,数据治理是被低估的金矿。

2026 年中国将推出 30 余项数据领域国家标准。「数据要素×」三年行动计划进入最后一年。公共数据、高质量数据集、数据基础设施——这些方向的标准化工作正在加速。

懂技术 + 懂合规 + 懂业务 = 市场上最稀缺的人。

本周小结

| 事件 | 一句话解读 |

|---|---|

| Databricks Genie Code | AI 自主写代码查数据,取数岗最先受冲击 |

| Snowflake Cortex Code GA | 跨平台 AI 编程代理,Snowflake 向外伸手了 |

| Flink CDC 3.6 + Flink Agents | 流处理引擎长出了 AI 大脑 |

| 就业市场收缩 | 初级岗变少,但高端需求依然旺盛 |

| 岗位定义重塑 | 从「数据分析师」到「AI 增强分析师」 |

如果只记住一件事,记住这个:

2026 年的数据行业不是在萎缩,是在分化。 会用 AI 工具、懂业务、能做架构决策的人,机会比以前更多。只是这列车不等人,你得自己跑起来。

我叫石头,在数据行业里摸爬滚打了十几年,这一轮 AI,我也是边看边想。这里写的,就是这些教训——我觉得值得说出来的那部分。

数据来源:Databricks AI/BI Release Notes 2026 · Snowflake Cortex Code · Apache Flink CDC 3.6.0 · Data Streaming Trends 2026 · 数据分析师 2026 就业形势 · Data Engineering Hiring Trends 2026 · Robert Half Tech Hiring 2026